El director ejecutivo de Open AI proyecta crear la mayor base de datos biométricos del mundo con otra de sus empresas, registrada en Islas Caimán

Sam Altman, el ejecutivo detrás de ChatGPT, ha escaneado el iris de más de dos millones de personas con una esfera metálica para demostrar que son humanos.

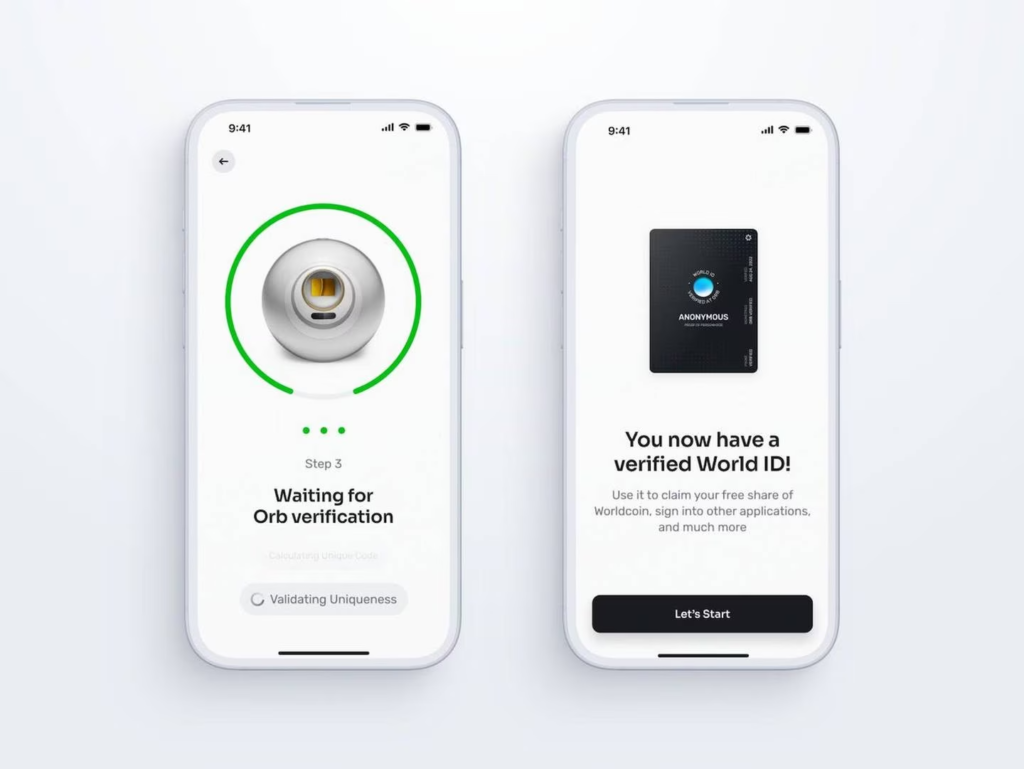

El proceso es sencillo: hay que instalar una aplicación en el móvil y recibir un código QR. Después, dejar que una esfera metálica te mire con su ojo y genere una “prueba de personalidad”. Entonces la prueba se asocia al código QR y la aplicación se transforma en un pasaporte llamado World ID, que es también el monedero de una criptodivisa llamada Worldcoin. En España, hay esferas en 14 centros comerciales para hacerlo.

¿Por qué querría alguien someterse a eso?, esa es la cuestión.

La respuesta es dinero. Antes del lanzamiento el pasado 26 de julio, Altman subcontrató cientos de “operadores” externos que cobran por ojo escaneado en países del Sur Global. En Indonesia ofrecieron camisetas, Airpods y vales por 25 Worldcoins que valoraron en 55 dólares (hoy valen la mitad). También organizaron talleres de criptomoneda en institutos para escanear a docenas de estudiantes, muchos menores de edad.

El “dinero” aún no es canjeable y Worldcoin se desentiende de los operadores arrestados o agredidos por ofrecer incentivos falsos o por los persistentes fallos técnicos. Kenia ha prohibido los registros porque sus agencias de protección de datos, seguridad y servicios financieros dudan de la autenticidad y legalidad de esas actividades. También hay escepticismo acerca del consentimiento de los usuarios, dado que los términos de cesión de datos no han sido traducidos al idioma local.

Altman asegura que pasaporte y monedero serán imprescindibles cuando la inteligencia artificial general haya superado a la nuestra y los humanos desempleados necesitemos recibir una renta universal. “Es improbable que la paguemos nosotros”, aclaró recientemente su mánager europeo, Ricardo Macieira, “pero queremos ser la infraestructura que permita a gobiernos y entidades hacerlo”.

La empresa se llama Tools for Humanity (Herramientas para la humanidad). Worldcoin opera desde una fundación registrada en las islas Caimán, un paraíso fiscal. Este diario (El País) ha intentado recabar la versión de Tools for Humanity por varios canales, sin obtener respuesta.

El relato filantrópico es un lugar común del capitalismo, pero para Sofie Henriksen, antropóloga especializada en la intersección de la acción humanitaria y los gigantes tecnológicos, esta última encarnación es especial. “Las tecnológicas son las primeras en usar abiertamente sus proyectos filantrópicos para testear nuevas tecnologías, expandir su cuota de usuarios o extraer datos personales para entrenar algoritmos —explica por correo—. Todas compiten por recaudar la mayor cantidad de datos posible”.

Las tecnológicas que descienden sobre países en desarrollo con servicios, aplicaciones e infraestructuras implementadas sin su consentimiento tienen su propio género académico: colonialismo digital.

Los datos biométricos son especialmente delicados porque son inmutables; no podemos cambiar de iris como cambiamos de nombre o dirección. Ofrecen gran potencial para el abuso porque permiten identificar personas de forma remota sin su consentimiento y se pueden asociar a parámetros discriminatorios, como demuestra el sistema automático de identificación de uigures, implementado por Huawei para el Gobierno chino. Worldcoin tiene dos antecedentes, uno humanitario y otro gubernamental.

La captura de datos biométricos se ha vuelto habitual en contextos migratorios, donde el escaneo de iris es condición para recibir ayuda humanitaria. En 2019, el Programa Mundial de Alimentos de Naciones Unidas se asoció con Palantir para optimizar esas operaciones, que hoy afectan a 160 millones de personas en 120 países. Worldcoin hereda su retórica. “En ambos casos, el escaneo de iris se presenta como una herramienta que garantizará una distribución justa de recursos, ya sea criptomonedas o ayuda y alimentos”, indica Henriksen. Los refugiados y las comunidades pobres donde Worldcoin ha recaudado el grueso de perfiles tienen poco margen de consentimiento y son vulnerables a la explotación.

El otro caso controversial es Aadhaar, la base de datos biométrica del Gobierno indio. La Administración de Modi ha codificado el registro de las huellas digitales y el iris de 1.000 millones de ciudadanos indios como una herramienta de participación ciudadana imprescindible para recibir pensiones gubernamentales, becas o programas de ayuda para combustible y alimentos. Sus críticos lo denuncian como el sistema de vigilancia masiva de un Gobierno totalitario en vías de radicalización.

Son 160 países los que registran sistemáticamente datos biométricos, pero una base de datos supranacional en manos de una empresa privada es mucho más peligrosa. “Hemos visto cómo Naciones Unidas compartía su registro biométrico de refugiados rohinyás con el Gobierno de Myanmar sin su consentimiento. Una empresa privada que subcontrata servicios en otros países dificulta mucho la rendición de cuentas cuando hay violaciones de derechos”, argumenta Henriksen.

Tools for Humanity ofrece su tecnología a cualquier organización o Gobierno que lo ayude a acelerar su expansión en Europa, Latinoamérica y África. Worldcoin asegura que la privacidad está garantizada porque el usuario no tiene que dar su nombre al hacer el registro y su iris se almacena como un código numérico abstracto. “Incluso si fuera cierto, y no tenemos forma de saberlo, la esfera puede acabar en malas manos”, explica Anna Bacciarelli, responsable de tecnología en Human Rights Watch.

Hay otro problema. El formulario de consentimiento que nadie lee dice que las esferas toman también imágenes en alta resolución de la cara, los ojos y el cuerpo del usuario, además de registrar signos vitales como el ritmo cardiaco o la respiración. Las autoridades de protección de datos francesa y alemana ven indicios de infracción de la normativa de datos europea (GDPR) y han iniciado conjuntamente una investigación.

Worldcoin se presenta como una infraestructura de código abierto, descentralizada y transparente. De momento es privativa, centralizada y opaca. Ha recaudado 240 millones de dólares de las firmas de capital riesgo más notorias de Silicon Valley, como Andreessen Horowitz, Tiger Global, Khosla Ventures y Coinbase Ventures. “La fuerte financiación del proyecto señala la enorme oportunidad de negocio”, señala Ella Jakubowska, especialista en biometría y derechos de la Asociación Europea de los Derechos Digitales. Hay un mercado evidente para la identificación de bots y usuarios sintéticos en las plataformas de servicios digitales. En ese sentido, Worldcoin parece el antídoto al otro proyecto de Altman, la empresa de IA generativa OpenAI.

Pero su objetivo manifiesto es involucrarse en los procesos democráticos y el acceso a la gestión de seguridad social, salario mínimo universal y becas de todo el mundo. Jakubowska lo encuentra siniestro. “Hacer un código de barras para cada habitante del planeta no tiene nada de humanitario. Worldcoin es la antítesis de una comunidad”.

La AAIP investiga el tratamiento de datos personales de Worldcoin en Argentina

El organismo inició una investigación por el tratamiento de datos sensibles.

La Agencia de Acceso a la Información Pública (AAIP), autoridad de Aplicación de la Ley 25.326 de Protección de Datos Personales, informa que está llevando adelante una investigación sobre el tratamiento de datos personales que realiza la Fundación Worldcoin en Argentina, con el objetivo de verificar las medidas de seguridad adoptadas en el marco de la protección de la privacidad de las y los usuarios de la aplicación digital.

La investigación analizará minuciosamente los procesos y prácticas en relación con la recopilación, almacenamiento y uso de datos personales, para identificar posibles afectaciones a los derechos reconocidos por la Ley 25.326. Además, se tomarán las medidas pertinentes para abordar cualquier problema identificado y garantizar que la empresa cumpla con los estándares de seguridad y privacidad.

El caso alcanzó notoriedad pública en las últimas semanas a causa del procedimiento de escaneo del rostro e iris de numerosas personas a cambio de una compensación económica en distintos puntos de la Ciudad Autónoma de Buenos Aires y de las provincias de Buenos Aires, Córdoba, Mendoza y Río Negro.

Siguiendo lo que establece la Ley de Protección de Datos Personales, es obligación de los responsables de tratamiento de datos contar con sus bases registradas en la AAIP, proporcionar información sobre su política de tratamiento, indicar para qué requieren datos sensibles y cuál es el tiempo de conservación de los mismos, así como también detallar las medidas de seguridad y confidencialidad que se aplican para resguardar la información personal.

Por su parte las y los ciudadanos tienen derecho, toda vez que se otorguen datos personales, a contar con información clara y accesible en relación a la cesión, uso y finalidad con la que se recolectan y tratan los datos, especialmente en lo que respecta a los datos sensibles, como es el caso de los biométricos. La AAIP cuenta con canales habilitados para realizar denuncias ante vulneraciones de los derechos de acceso, rectificación y supresión de datos personales.

Casos como éste visibilizan la necesidad de fortalecer el marco legal vigente en materia de Protección de Datos Personales, tal como ha sido planteado en reiteradas oportunidades y en diversos foros, nacionales e internacionales, por la AAIP. La Argentina cuenta con una regulación que ha cumplido más de 20 años desde su sanción y requiere ser actualizada para enfrentar eficazmente los desafíos en materia de privacidad que plantean las transformaciones tecnológicas recientes.

Esta realidad es la que motiva la necesidad de impulsar el Proyecto de Ley elaborado por la Agencia y remitido por el Poder Ejecutivo Nacional, en el mes de junio, al Congreso de la Nación; y que fuera presentado por la titular de la AAIP, Beatriz Anchorena, el pasado martes en la Honorable Cámara de Diputados de la Nación, en una reunión conjunta de las comisiones de Asuntos Constitucionales y Legislación General.

La AAIP despliega acciones investigativas en casos como este y apela, desde sus distintas acciones, a la responsabilidad de quienes realizan el tratamiento de datos así como también a la conciencia de las y los ciudadanos sobre sus derechos, sensibilizando acerca de la importancia de resguardar la privacidad de los datos personales en la era digital.